La recherche de la vie extraterrestre a toujours été confrontée à un défi majeur : comment reconnaître la vie sous des formes qui pourraient être radicalement différentes de celles que nous connaissons sur Terre ? Les missions spatiales, notamment celles qui explorent des lunes telles qu’Europe (de Jupiter) et Titan (Saturne), cherchent des signes de vie dans des environnements qui pourraient abriter des formes de vie très différentes de celles basées sur la chimie du carbone et de l’eau, familières sur notre planète.

La théorie de l’assemblage, dans ce contexte, offre une approche inédite pour la détection de la vie extraterrestre. Contrairement aux méthodes traditionnelles qui recherchent des biomarqueurs spécifiques ou des signatures chimiques associées à la vie telle que nous la connaissons, la théorie de l’assemblage adopte une approche « chimiquement agnostique ».

Elle cherche à identifier les molécules ou les assemblages moléculaires qui portent les marques d’une histoire d’assemblage complexe, indépendamment de leur chimie spécifique. Cette approche peut permettre aux scientifiques d’identifier des signes de vie dans des environnements qui étaient auparavant considérés comme trop exotiques ou trop éloignés de la chimie de la vie terrestre pour être compatibles avec l’existence d’entités vivantes.

Elle propose une vision renouvelée de l’émergence de la complexité, en intégrant le temps et l’histoire de l’assemblage moléculaire comme éléments centraux. Elle pourrait orienter de nouveaux projets de recherche de vie extraterrestre. Toutefois, elle se heurte à des défis critiques et suscite un débat animé parmi les scientifiques, oscillant entre scepticisme et curiosité.

L’exploration des mécanismes fondamentaux qui sous-tendent la complexité de la vie et de l’univers a toujours été au cœur des interrogations scientifiques. Aujourd’hui, alors que les missions spatiales scrutent des mondes lointains en quête de signes de vie et que les biologistes sondent les profondeurs de la machinerie moléculaire, une question persiste : comment la complexité émerge-t-elle dans notre univers ?

Récemment, la théorie de l’assemblage, développée par Lee Cronin de l’Université de Glasgow et Sara Walker de l’Arizona State University, propose une nouvelle perspective sur la complexité et l’origine de la vie, en mettant en avant le rôle fondamental du temps et de l’histoire dans la formation des entités complexes. Cette théorie, qui a suscité un intérêt et un scepticisme variés au sein de la communauté scientifique, suggère que la complexité des molécules et des entités vivantes ne peut être comprise qu’en tenant compte de l’ensemble de leur histoire de formation. Les travaux sont publiés dans la revue Nature.

La complexité à travers le temps

La théorie de l’assemblage, mise en avant par les chercheurs Lee Cronin et Sara Walker, introduit une perspective novatrice sur la manière dont les structures complexes, notamment les molécules biologiques, se forment et évoluent. Cette théorie s’écarte de l’idée conventionnelle selon laquelle les molécules complexes peuvent simplement émerger à partir d’un panel de possibilités combinatoires.

Au lieu de cela, Cronin et Walker avancent que l’histoire de l’assemblage des molécules, c’est-à-dire les étapes et les processus par lesquels elles se sont formées, est un élément crucial pour comprendre leur complexité. Ils suggèrent que cette histoire est, d’une certaine manière, « enregistrée » ou encodée dans les molécules elles-mêmes, influençant ainsi leur comportement et leurs interactions futures.

Pour quantifier cette complexité, la théorie introduit le concept d’Indice d’Assemblage (AI). L’AI est calculé en déterminant le nombre minimum d’étapes nécessaires pour assembler un objet ou une structure à partir de ses composants de base. Plus le nombre d’étapes est élevé, plus l’AI est élevé, indiquant une plus grande complexité dans l’histoire de l’assemblage de l’objet. Cette mesure offre une méthode pour évaluer et comparer la complexité des entités moléculaires, en tenant compte non seulement de leur structure actuelle, mais aussi des processus qui les ont formées.

Les univers d’assemblage

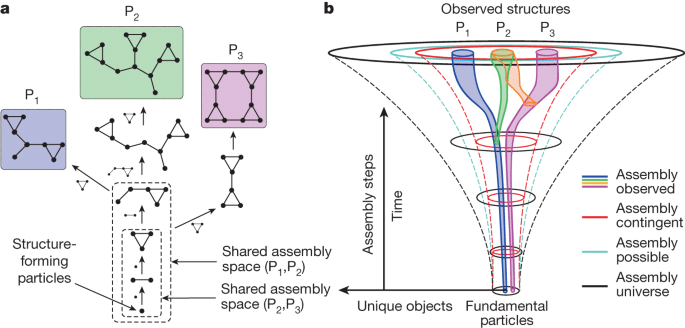

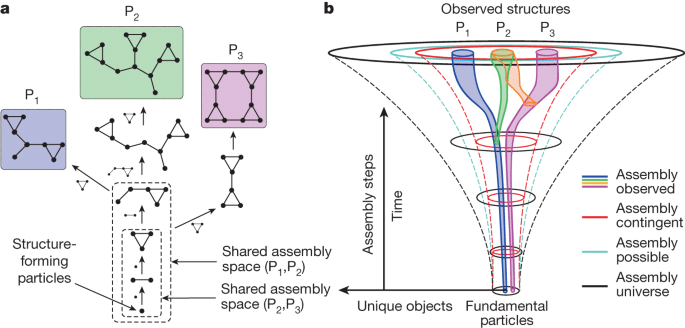

La théorie identifie quatre « univers » distincts. Le premier est l’univers de l’Assemblage. Il est envisagé comme un espace conceptuel où tous les assemblages possibles existent, sans égard aux lois physiques ou aux contraintes temporelles, offrant une vue d’ensemble des possibilités infinies dans le domaine de l’assemblage moléculaire. Ensuite, l’Assemblage Possible se réfère à tous les assemblages qui peuvent théoriquement se former en respectant les lois de la physique, servant de pont entre le conceptuel et le réalisable.

L’Assemblage Contingent, quant à lui, prend en compte l’histoire et le contexte spécifique dans lequel l’assemblage se produit, reconnaissant que les voies d’assemblage sont influencées par les conditions initiales et les étapes précédentes dans le processus. Enfin, l’Assemblage Observé est ce que nous pouvons actuellement détecter et étudier, les structures qui ont non seulement été formées en respectant les lois physiques et les contraintes historiques, mais qui sont également accessibles à nos instruments et méthodes d’observation.

(a) Illustration de l’assemblage de trois objets (P1, P2, P3) et de leur espace d’assemblage commun. (b) Représentation de l’expansion de l’univers de l’assemblage, montrant divers aspects de l’assemblage et soulignant la structure imbriquée des espaces, sans indiquer leur taille relative. © A. Sharma et al., 2023

(a) Illustration de l’assemblage de trois objets (P1, P2, P3) et de leur espace d’assemblage commun. (b) Représentation de l’expansion de l’univers de l’assemblage, montrant divers aspects de l’assemblage et soulignant la structure imbriquée des espaces, sans indiquer leur taille relative. © A. Sharma et al., 2023

Ces univers, bien que distincts, ne sont pas isolés les uns des autres, mais sont interconnectés, reflétant la transition des entités de l’abstrait vers le concret. En utilisant des concepts tirés de la théorie des graphes, la théorie de l’assemblage tente de cartographier les chemins à travers ces univers.

La professeure Sara Walker explique dans un communiqué : « La théorie de l’assemblage offre une toute nouvelle perspective pour considérer la physique, la chimie et la biologie comme des perspectives différentes de la même réalité sous-jacente ».

La recherche de la vie extraterrestre a toujours été confrontée à un défi majeur : comment reconnaître la vie sous des formes qui pourraient être radicalement différentes de celles que nous connaissons sur Terre ? Les missions spatiales, notamment celles qui explorent des lunes telles qu’Europe (de Jupiter) et Titan (Saturne), cherchent des signes de vie dans des environnements qui pourraient abriter des formes de vie très différentes de celles basées sur la chimie du carbone et de l’eau, familières sur notre planète.

La théorie de l’assemblage, dans ce contexte, offre une approche inédite pour la détection de la vie extraterrestre. Contrairement aux méthodes traditionnelles qui recherchent des biomarqueurs spécifiques ou des signatures chimiques associées à la vie telle que nous la connaissons, la théorie de l’assemblage adopte une approche « chimiquement agnostique ».

Elle cherche à identifier les molécules ou les assemblages moléculaires qui portent les marques d’une histoire d’assemblage complexe, indépendamment de leur chimie spécifique. Cette approche peut permettre aux scientifiques d’identifier des signes de vie dans des environnements qui étaient auparavant considérés comme trop exotiques ou trop éloignés de la chimie de la vie terrestre pour être compatibles avec l’existence d’entités vivantes.

Référence

https://www.researchgate.net/publication/361134768_Assembly_Theory_Explains_and_Quantifies_the_Emergence_of_Selection_and_Evolution

Authors:

Abhishek Sharma,

Since the time of Darwin, scientists have struggled to reconcile the evolution of biological forms in a universe determined by fixed laws. These laws underpin the origin of life, evolution, human culture and technology, as set by the boundary conditions of the universe, however these laws cannot predict the emergence of these things. By contrast evolutionary theory works in the opposite direction, indicating how selection can explain why some things exist and not others. To understand how open-ended forms can emerge in a forward-process from physics that does not include their design, a new approach to understand the non-biological to biological transition is necessary. Herein, we present a new theory, Assembly Theory (AT), which explains and quantifies the emergence of selection and evolution. In AT, the complexity of an individual observable object is measured by its Assembly Index (a), defined as the minimal number of steps needed to construct the object from basic building blocks. Combining a with the copy number defines a new quantity called Assembly which quantifies the amount of selection required to produce a given ensemble of objects. We investigate the internal structure and properties of assembly space and quantify the dynamics of undirected exploratory processes as compared to the directed processes that emerge from selection. The implementation of assembly theory allows the emergence of selection in physical systems to be quantified at any scale as the transition from undirected-discovery dynamics to a selected process within the assembly space. This yields a mechanism for the onset of selection and evolution and a formal approach to defining life. Because the assembly of an object is easily calculatable and measurable it is possible to quantify a lower limit on the amount of selection and memory required to produce complexity uniquely linked to biology in the universe.

(a) Illustration de l’assemblage de trois objets (P1, P2, P3) et de leur espace d’assemblage commun. (b) Représentation de l’expansion de l’univers de l’assemblage, montrant divers aspects de l’assemblage et soulignant la structure imbriquée des espaces, sans indiquer leur taille relative. © A. Sharma et al., 2023

(a) Illustration de l’assemblage de trois objets (P1, P2, P3) et de leur espace d’assemblage commun. (b) Représentation de l’expansion de l’univers de l’assemblage, montrant divers aspects de l’assemblage et soulignant la structure imbriquée des espaces, sans indiquer leur taille relative. © A. Sharma et al., 2023